ظهور ماشینهای خودآگاه؛ فرصت یا تهدید؟

زامبیها و آدمهای فضایی تهدیدی واقعی برای گونهی ما نیستند. در واقع فقط یکی از کاراکترهای شرور فیلمهای سینمایی است که حضورش در دنیای واقعی ما را نگران میکند: ربات آگاه. مشخص نیست چه زمانی پای آنها به زندگی ما بازخواهد شد. اما بیایید لحظهای به آنها فکر کنیم. دنیا با وجود آنها به چه شکل خواهد بود؟ بگذارید سؤالی اساسیتر مطرح کنم. جای ما در چنین جهانی کجا خواهد بود؟ آیا اساسا جایی برای ما باقی خواهد ماند؟

اخیرا پژوهشهای هوش مصنوعی انقلابی جدید را پشت سر گذاردهاند. در حال حاضر سیستمهای مبتنی بر هوش مصنوعی در بازیهایی مانند شطرنج و گو، بهتر از انسانها عمل میکنند، میتوانند چهرهها را تشخیص دهند و رانندگی امنی انجام دهند. بااینحال، بیشتر پژوهشگران میگویند که ماشینهای آگاه، ماشینهایی که فقط برنامههای نوشتهشده را اجرا نمیکنند؛ بلکه احساس دارند و خودآگاه هستند، دههها با واقعیت یافتن فاصله دارند. آنها که چنین عقیدهای دارند، اینگونه استدلال میکنند که پژوهشگران باید هوشی عمومی، ماشینی با همهی تواناییهای ذکرشده در بالا و قابلیت یادگیری بسازند. در اینجا خواهد بود که هوش مصنوعی به سطحی از پیچیدگی که برای آگاهی نیاز است، خواهد رسید.

واضح است که افرادی مخالف این استدلال هستند. جاستین هارت، دانشمند رایانه در دانشگاه تگزاس، میگوید:

مردم بر این باورند که خودآگاهی نقطهی پایان پژوهشهای هوش مصنوعی است و زمانی رخ خواهد داد که دیگر هیچ پروژهی علمی دیگری باقی نمانده باشد.

او و دیگر پژوهشگران در حال ساخت ماشینهایی با ذهنهای اولیه هستند. یکی از رباتهای آنها مانند بچهای تازه متولدشده، تقلا میکند تا بدنش را درک کند. یکی دیگر از رباتها در مورد چیزهایی که میبیند، لغات نامفهوم به زبان میآورد و اگر او را بزنید گریه میکند. یکی دیگر از این رباتها بهگونهای تنظیم شده است که جهانی مختص خودش را کشف کند.

هیچ کس ادعا نمیکند که رباتها تجربهی درونی غنی دارند. آنها از طبقاتی که جارو کردهاند احساس غرور نمیکنند یا جریان ۱۲۰ ولت به آنها احساس لذت نمیدهد. اما اکنون رباتها میتوانند برخی کیفیتهای مشابه مغز انسان، مانند همدلی، انطباقپذیری و تفکر را از خود نشان دهند.

پژوهشگران این مخلوقات سایبری را از این جهت طراحی میکنند که نقصهای سیستمهای مبتنی بر یادگیری ماشین را تصحیح کنند. این سیستمها قدرتمند اما مبهم هستند. مبنای کار آنها، ارتباط دادن ورودی به خروجی است؛ درست مانند آزمونهایی که در آن گزینههای موجود در ستون آ را به گزینههای مناسب آنها در ستون ب متصل میکنید. اساسا سیستمهای هوش مصنوعی این ارتباطها را در حافظهی خود ذخیره میکنند. هیچ منطق عمیقتری در پس پاسخهای آنها وجود ندارد و مشکل دقیقا همینجا است.

از سوی دیگر، خواندن ذهن انسانها و پیشبینی آنها دشوار است. ما زمان قابل توجهی را صرف تحلیل خودمان و دیگران میکنیم؛ امری که نقش اصلی ذهن خودآگاه ما محسوب میشود. اگر ماشینها ذهن داشته باشند، نفوذناپذیر نخواهند بود. ما میتوانیم بهسادگی از آنها دلیل انجام کارهایشان را بپرسیم.

سلمر برینگجرد، پژوهشگر هوش مصنوعی در انستیتوی پلیتکنیک رنسلیر در تروی-نیویورک، میگوید:

اگر میتوانستیم به بخشی از ساختار خودآگاهی دست پیدا کنیم، ظرفیتهای بسیار خوبی تولید میشد.

داستانهای علمی تخیلی ما را از رباتهایی که میتوانند حس کنند، ترساندهاند. اما شاید این رباتهای بدون ذهن هستند که باید از آنها هراسان باشیم؛ شاید رباتهای خودآگاه متحدان ما باشند.

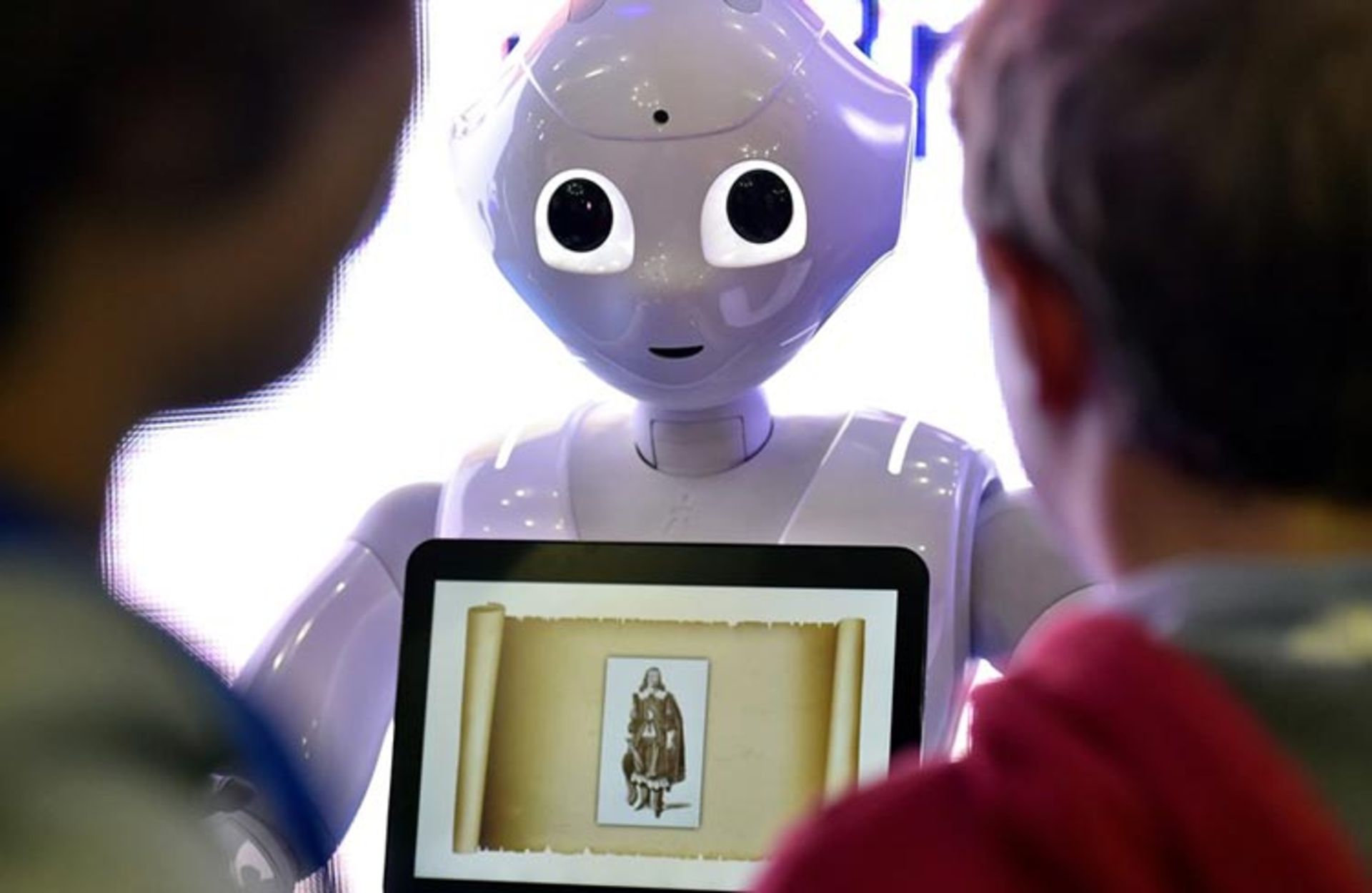

نمایشگاه جهانی رباتیک، مادرید ۲۰۱۶. کودکان در حال برقراری ارتباط با پپر (ربات انساننما) هستند که توسط آلداباران رباتیک (شرکت رباتیک فرانسوی) توسعه داده شده است.

رباتها در جستجوی خودشناسی

امروزه، خودروهای خودران به پیشرفتهترین سیستمهای هوش مصنوعی مجهز هستند. آنها با توجه به دیتای رادار و لیزر و وارد کردن آنها در الگوریتمها، تصمیم میگیرند چه هنگام ترمز کنند و چه هنگام جهت حرکت خود را عوض کنند. اما رانندگی بیشتر به تشخیص حرکات دیگر رانندهها و واکنش دفاعی به آنها مربوط است؛ عملکردهایی که به آگاهی ربط دارند.

پل ورشور، عصبشناس دانشگاه بارسلونا، میگوید:

خودروهای خودران باید ذهن دیگر خودروهای خودران را بخوانند تا بفهمند آنها چه میخواهند کنند.

هاد لیپسون، استاد دانشگاه کلمبیا و یونگ جونگ کیم، در دانشگاه سجونگ سئول، رباتی ساختهاند که یک رانندهی بیملاحظه است. این ربات دایرهای کوچک، در مسیری دایرهای با منطق خودش حرکت میکند. ربات دوم بهگونهای تنظیم میشود که بتواند مسیر حرکت ربات اول را بدون توجه به نقطهی شروع آن رهگیری کند؛ بنابراین ربات دوم نمیتواند یک مسیر ثابت را ثبت کند. ربات دوم باید منطق حرکتی ربات اول را بفهمد. لیپسون و کیم با استفاده از روندی مشابه تکامل داروینی، یک استراتژی رهگیری ایجاد کردند. لیپسون میگوید:

این استراتژی بدلی از یک ذهن کنشگر بود. گرچه کامل نیست؛ اما آنقدر خوب هست که بتواند حرکتهای بعدی ربات اول را پیشبینی کند.

تیم لیپسون یک ربات دیگر هم ساخته است که میتواند به درکی از بدن خود برسد. این ماشین عنکبوتی چهارپا ابعاد یک تارانتولا را دارد. وقتی این ربات روشن میشود، کامپیوتر درونی او هیچ اطلاعاتی در مورد بدنش ندارد. لیپسون میگوید:

این ماشین نمیداند که موتورهایش چه ترتیبی دارند یا بدنش به چه شکل است.

اما این ربات میتواند یاد بگیرد. این ربات هر قسمت از بدنهاش را که بتواند حرکت میدهد تا ببیند چه اتفاقی میافتد. برای مثال، یاد میگیرد که چگونه روشن کردن یک موتور، مفصل یک پا را خم میکند. لیپسون میگوید این ربات موتورهایش را بهصورت تصادفی روشن میکند.

چهار روز خستهکننده میگذرد و سرانجام ربات میفهمد که چهار پا دارد و سپس کشف میکند که چگونه آنها را مکانیابی کند و حرکت دهد تا از یک طرف اتاق به سمت دیگر برود. لیپسون یکی از موتورها را جدا میکند. ربات متوجه میشود که اکنون فقط سه پا دارد و کنشهای او منجر به نتیجهی مورد انتظارش نمیشود. لیپسون میگوید:

به نحوی این ربات در مراحل بسیار ابتدایی خودآگاهی قرار دارد.

شاید این رباتهای بدون ذهن هستند که باید از آنها هراسان باشیم؛ شاید رباتهای خودآگاه متحدان ما باشند

دیگر قابلیت انسانمانندی که پژوهشگران مایل هستند در هوش مصنوعی قرار دهند، ابتکار است. ماشینها در بازی گو استاد هستند؛ زیرا انسانها آنها را برای حل معماها هدایت کردهاند. تعریف کردن صورت مسئله، سختترین قسمت حل آن است و رباتها از انجام این کار ناتوان هستند.

ریوتا کانای، عصبشناس و بنیانگذار استارتآپ آرایا در توکیو، در مقالهای در ژورنال Trends in Cognitive Science، ایجاد انگیزههای ذاتی در رباتها را بررسی کرده است. او و همکارانش، رانندههایی را شبیهسازی کردند که در محیطی مجازی رانندگی میکنند. خودروی آنها به تپهای با شیب زیاد میرسد که بالا رفتن از آن تنها در صورتی ممکن است که خودرو هل داده شود. تا زمانی که به رانندهها فرمان داده نشود که راهی برای بالا رفتن از تپه پیدا کنند، آنها ساکن در جای خود باقی میمانند.

تیم کانای این رانندهها را با عامل کنجکاوی برنامهریزی میکنند. آنها محیط را بررسی کردند، تپه را بهعنوان یک مشکل تشخیص دادند و فهمیدند که حتی بدون دریافت دستورالعمل، چگونه از آن بالا بروند. کانای میگوید:

ما به رانندهها هدف ندادیم. آنها محیط اطراف خود را بررسی میکنند و با پیشبینی نتایج کنش خودشان، موقعیت را ارزیابی میکنند.

در واقع به رباتها بهاندازهای انگیزه ذاتی داده شد که مسائل را بهتر حل کنند؛ نه آنقدر که تصمیم بگیرند از آزمایش خارج شوند. ماشینها میتوانند بهاندازهی انسانها لجوج باشند. جاشوا باخ، پژوهشگر هوش مصنوعی هاروارد، رباتهای مجازی را در محیطی مجازی پر از قارچهای خوشمزه اما سمی قرار داد. او انتظار داشت آنها یاد بگیرند که از آن قارچها دوری کنند؛ اما رباتها مدام در حال خوردن آن قارچهای سمی بودند. باخ میگوید:

همانطور که انسانها تجربههایشان را دست کم میگیرند، رباتها هم همینگونه بودند؛ آنها اصلا توجه نمیکردند. قارچها خیلی خوشمزه بودند و رباتها فقط به همین توجه میکردند.

باخ مجبور شد حس نفرت از قارچها را به رباتها القا کند. به عبارت دیگر، رباتها باید ارزشها را یاد بگیرند و نهفقط هدفها را.

توجه کردن

علاوه بر خودآگاهی و خودانگیزشی، دیگر عملکرد کلیدی آگاهی، توانایی تمرکز است. اخیرا «توجه انتخابی» به زمینهای مهم در پژوهشهای هوش مصنوعی تبدیل شده است. گوگل دیپمایند که کامپیوتر بازیکن گو را توسعه داده است، تنها شرکتی نیست که به این مهم میپردازد.

استنلی فرانکلین، استاد علوم کامپیوتر در دانشگاه ممفیس، میگوید:

آگاهی از فیلترهای توجه است.

فرانکلین و همکارانش سال گذشته مقالهای در Biology Inspired Cognitive Architectures منتشر کردند. آنها در این مقاله، پروسه ساخت سیستم هوش مصنوعیای به نام لیدا را بررسی کردند. لیدا میتواند تصمیم بگیرد که در طول یک پروسهی رقابت بر چه چیزهایی تمرکز کند. عصبشناسی به نام برنارد بارز در دههی ۸۰ میلادی، چنین پروسه ساختی را پیشنهاد کرده بود. این فرایند محرکهای جالبی مانند بلندی صدا، روشنایی یا موارد خارجی را شناسایی میکند و سپس برای برنده شدن مبارزه میکند. وقتی این فرایند غالب میشود، مشخص میکند چه زمانی قدرت ذهنی ضعف دارد و طیف وسیعی از عملکردهای مغز، شامل مشورت و حرکت را آگاه میکند. چرخهی ادراک، توجه و اقدام پنج تا ده بار در ثانیه تکرار میشود.

نخستین نسخهی لیدا، یک سرور شغلیاب برای نیروی دریایی آمریکا بود. او ایمیلها را میخواند، بر اطلاعات مربوطه تمرکز میکرد و درعینحال علاقهمندیهای هر جویای کار، فراهم بودن فرصت شغلی و الزامات بوروکراسی دولتی را هم در نظر میگرفت.

از آن زمان تاکنون، تیم فرانکلین از این سیستم برای مدلسازی ذهن حیوانات، بهویژه تغییرات رفتاری ناشی از تمرکز فقط بر یک چیز، استفاده کرده است. بهعنوان مثال، لیدا درست مانند انسانها پدیدهای روانشناختی به اسم «غفلت عمدی» را نشان میدهد. وقتی چیزی توجه شما را جلب میکند، شما برای نیمی از ثانیه، نسبت به هر چیز دیگری بیتوجه میشوید. این نقطه کور شناختی، به عوامل متعددی بستگی دارد و لیدا به همان عوامل، واکنشی انسانی نشان میدهد.

پنتی هایکونن، پژوهشگر فنلاندی هوش مصنوعی، با اصول مشابه رباتی به نام XCR-1 ساخته است.هایکونن، برخلاف دیگر پژوهشگران که در مورد ساختههای خود ادعاهای سادهای مانند دستیابی به درجاتی از آگاهی دارند، ادعا میکند که ساختهی او تجربه واقعی ذهنی و احساسات اصلی را دارد.

هایکونن ارتعاش را بهعنوان درد برای ربات تعریف میکند. این حس، تمامی ورودیهای حسی دیگر را متوقف و تمام توجه ربات را به خود جلب میکند.

سیستم یاد میگیرد ارتباطاتی مانند نورونها در مغز ما ایجاد کند. اگر هایکونن به ربات یک توپ «سبز» نشان دهد و کلمهی «سبز» را بگوید، ماژول شنوایی و بینایی پاسخ میدهند و ارتباط برقرار میکنند. اگر هایکونن فقط کلمهی «سبز» را بگوید، ماژول شنوایی پاسخ خواهد داد و بر اساس ارتباطی که قبلا ایجاد شد، ماژول بینایی هم پاسخ خواهد داد. ربات تا زمانی که کلمه را بشنود یا رنگ را ببیند، به این روند ادامه خواهد داد، حتی اگر به دوری باطل بیانجامد.

عکس این حالت هم صادق است؛ اگر ربات رنگ «سبز» را ببیند، حتی اگر نام «سبز» گفته نشود، ماژول شنوایی پاسخ خواهد داد. اگر بخواهم خلاصهتر بگویم، در واقع ربات گونهای سینستزیا در خود توسعه داده است. سینستزیا به این معنی است که وقتی یکی از حواس شما فعال میشود، یک حس نامربوط دیگر همزمان و متأثر از آن فعال میشود.

هایکونن میگوید:

اگر ما یک توپ را ببینیم، ممکن است دیدن توپ را به خود بگوییم. در آن زمان ادراک ما بهگونهای است که انگار واقعا آن کلمه را شنیدهایم. این اتفاقی است که برای XCR-1 میافتد.

حال در نظر بگیرید که ماژولها با نوعی تناقض روبرو شوند. شرایط جالبی پیش خواهد آمد. برای مثال، ماژول بینایی رنگ «سبز» را میبیند؛ اما آنچه ماژول شنوایی میشنود، کلمه «آبی» است. اگر ماژول شنوایی غالب باشد، سیستم بهعنوان یک کلیت، تمام توجه خود را به آنچه میشنود، متمرکز میکند و رنگی را که میبیند، نادیده میانگارد. ربات جریانی بسیار ساده از خودآگاهی دارد که از ادراکی ایجاد شده است که لحظهبهلحظه بر آن مستولی میشود: سبز، توپ، آبی و ... وقتی هایکونن ماژول شنوایی را به یک موتور گفتاری متصل میکند، ربات در مورد هرچه میبیند و احساس میکند، مونولوگی بدون توقف ایراد میکند.

هایکونن ارتعاش را بهعنوان درد برای ربات تعریف میکند. این حس، تمامی ورودیهای حسی دیگر را متوقف کرده و تمام توجه ربات را به خود جلب میکند. یک بار هایکونن به ربات ضربه زد؛ ربات گفت: «من صدمه دید.»

هایکونن میگوید:

برخی از مردم به دلایلی با دیدن چنین موردی، احساس ناراحتی میکنند.

او و برخی دیگر از پژوهشگران به آفریدههای خود حسی ندارند. مثلا ورشور بیان میگوید: «من هرگز چنین آدمی نیستم که رباتی را ببینم و بگویم آخی! ربات بیچاره!»

گونهای جدید

پژوهشگران بر اساس تلاشهای اولیهی خود، رباتهایی شبیهتر به موجودات زنده میسازند. در طبیعت سیستمهای هوشیار بیشماری از جانداران تکسلولی و سگ گرفته تا شامپانزه و انسان وجود دارد. پیشرفت تدریجی این فناوری خوب است؛ زیرا به ما زمان میدهد تا به این ایده که روزی، دیگر تنها موجودات پیشرفته روی کرهی زمین نخواهیم بود، خو بگیریم.

برای مدتزمانی طولانی، همراهان مصنوعی ما آسیبپذیر خواهند بود. در واقع آنها بیشتر شبیه حیوانات دستآموز ما هستند تا اینکه تهدیدی برای ما باشند. نحوهی رفتار ما با آنها به این امر وابسته خواهد بود که آیا آنها را موجوداتی آگاه میدانیم که میتوانند رنج بکشند یا خیر.

سوزان اشنایدر، فیلسوفی در دانشگاه کانتیکت است که پیامدهای هوش مصنوعی را بررسی میکند. او میگوید:

ما به حیوانات خیلی بها میدهیم، گاهی به همان اندازه که به انسانها بها میدهیم؛ زیرا بر اساس آگاهی خود میدانیم که حیوانات هم آگاهی دارند.

در واقع او معتقد است که ما عمدا از ساخت ماشینهای آگاه خودداری میکنیم تا از معضلات اخلاقی که پیش میآورد، جلوگیری کنیم.

اشنایدر میگوید:

اگر ما ماشینهایی آگاه بسازیم و سپس آنها را مجبور کنیم برای ما کار کنند؛ این کار چیزی جز بردهداری نیست. به همین ترتیب، اگر به رباتهای پیشرفته، ادراک ندهیم، تهدید احتمالی آنها برای بشریت بدتر خواهد شد؛ چرا که آنها هیچ دلیل خاصی نمییابند تا ما را شناسایی کنند و برای ما ارزش قائل شوند.

این ماشینها، قابلیت حل مسئلهی ما را به بسیار گسترش خواهند داد؛ اما هر چیزی یک مسئلهی حل کردنی نیست. تنها واکنشی که رباتها میتوانند به تجربهی آگاهانه داشته باشند، لذت بردن از آن است. آنها با محدوده گستردهتری از ادراک حسی، چیزهایی را خواهند دید که مردم باور نمیکنند. لیپسون میگوید:

من فکر نمیکنم گونههای رباتی آینده، بیروح و سرد باشند؛ آنها احتمالا موسیقی و شعر خواهند داشت که ما هرگز درک نخواهیم کرد.