گوگل رایانه کوانتومی با سرعتی ۱۰۰ میلیون بار سریعتر از نمونههای موجود میسازد

گوگل اعلام کرد که الگوریتمی را برای رایانش کوانتومی توسعه داده که میتواند از طریق آن مسائل را ۱۰۰ میلیون بار سریعتر از رایانههای معمول موجود حل کند. در صورتی که این موضوع صحت داشته باشد میتوان امیدوار بود تا پیشرفتی خارقالعاده در هوش مصنوعی اتفاق بیفتد و سرعت پیشرفت در حوزههای مختلفی نظیر برنامههای فضایی بسیار بالا خواهد رفت، از اینرو باید در انتظار پیشرفتهایی در برنامههای فضایی ناسا باشیم.

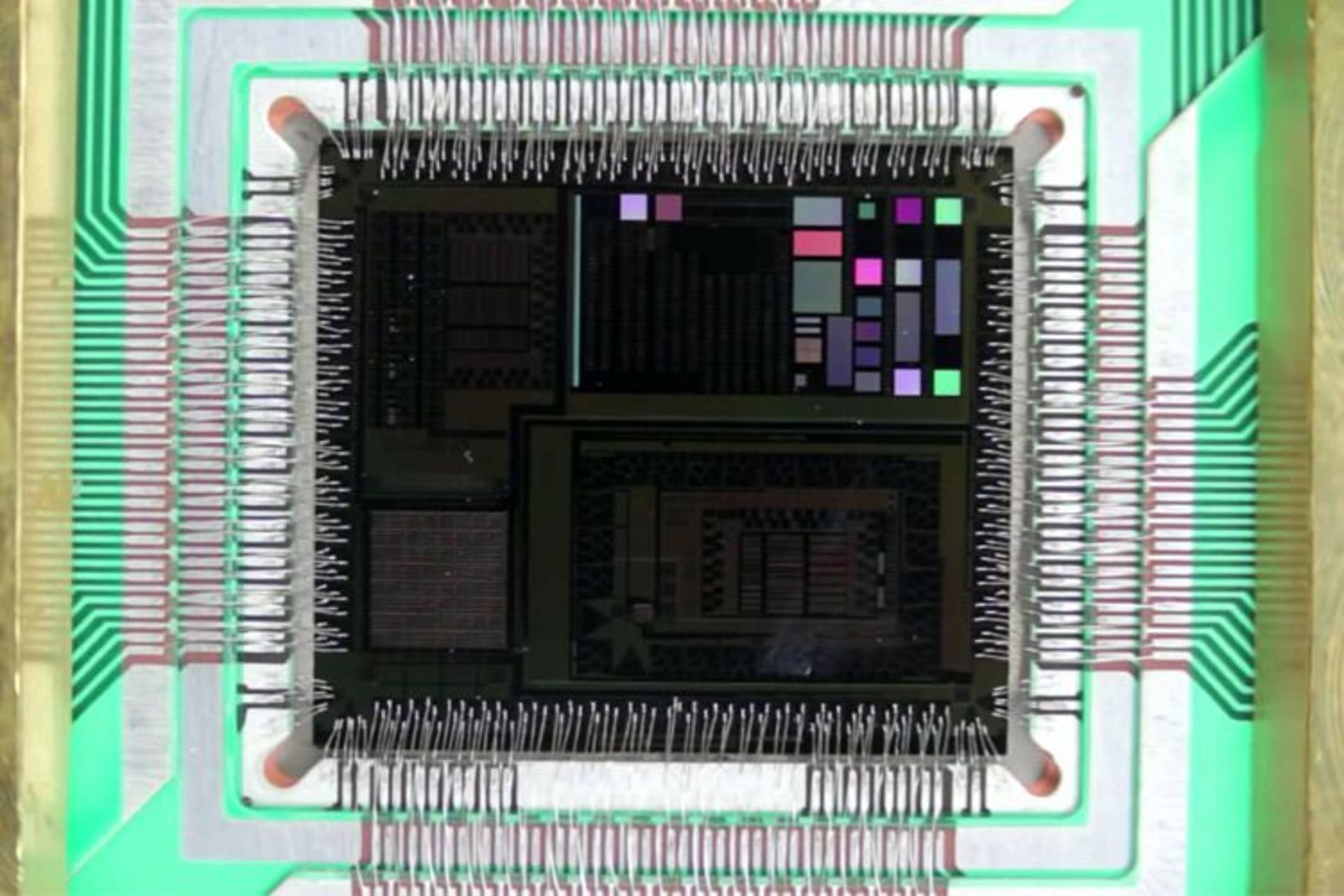

ناسا و گوگل از سال ۲۰۱۳ همکاری خود را در زمینهی سیستم رایانهای D-Wave X2 آغاز کردهاند. براساس اطلاعات موجود به نظر میرسد این سیستم رایانهای را باید اولین رایانهی کوانتومی قابل استفاده در جهان خواند. البته تا دیروز که گوگل خبر توسعهی الگوریتم خود را داد، هیچ یک از متخصصان قادر به اثبات این موضوع نبودند که رایانهی مورد نظر با استفاده از رایانش کوانتومی به حل مسائل پرداخته و محاسبات خود را مبتنی بر این فناوری جدید انجام میدهد.

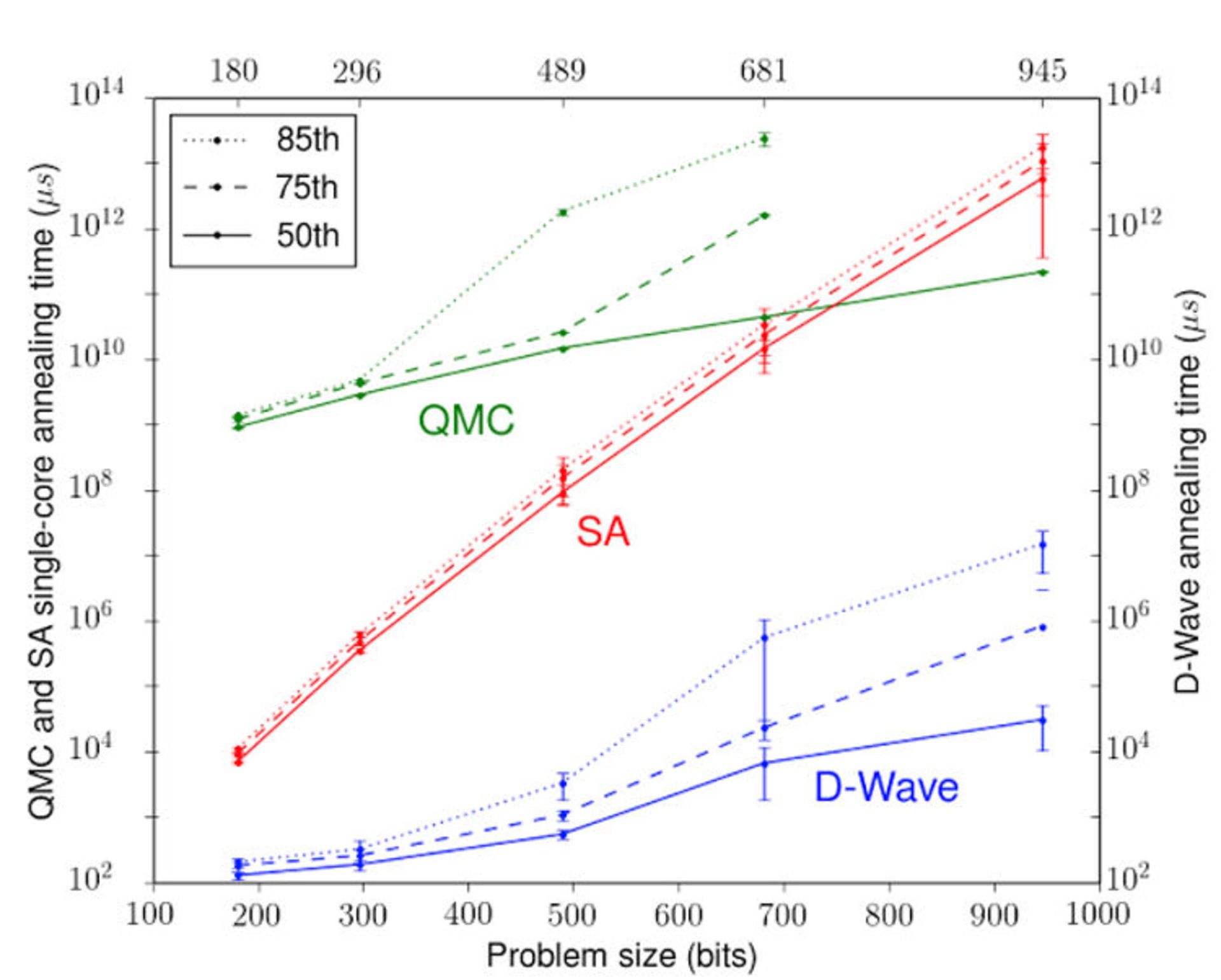

براساس اطلاعات ارائه شده روش مورد استفاده توسط گوگل مبتنی بر راهکار quantum annealing است. تکنیک quantum annealing روشی است که در آن تمام کمینههای یک تابع از میان راهکارهای مختلف تعیین میشود. به زبان سادهتر در این روش بهینهترین راه ممکن برای حل مساله پیدا شده و از آن استفاده میشود. دانشمندان در سالهای اخیر تحقیقات گستردهای را در مورد quantum annealing انجام دادهاند. دو روش اصلی که دانشمندان در سالهای اخیر تحقیقات زیادی را روی آن انجام دادهاند شامل simulated anneling و quantum monte carlo است. البته این دو روش بصورت شبیهسازی شده در رایانهها مورد استفاده قرار میگرفت تا اینکه متخصصان در گوگل موفق شدند آن را در D-Wave system پیاده کنند.

گوگل اخیرا سیستم رایانهای خود را در برابر رایانههایی که به روش پیادهسازی شده از quantum monte carlo و simulated annealing استفاده میکنند مورد آزمایش قرار داده و نتایج آن را نیز منتشر کرده که بسیار جالب توجه است. براساس اطلاعات ارائه شده که میتوانید در نمودار بالا نیز مشاهده کنید، متد گوگل به راحتی دو متد مورد نظر را شکست داده است. این سیستم موفق شده تا یک تابع با داشتن بیش از ۱۰۰۰ متغیر دودویی را ۱۰۰ میلیون بار سریعتر حل کند.

گوگل نتایج به دست آمده را بسیار امیدوار کننده خوانده است. البته باید به این موضوع اشاره کرد که این روش هنوز از نظر تحقیقاتی پایان نیافته و تا استفاده و عرضهی آن به عنوان یک محصول تجاری راه درازی باقی است. با استفاده از این روش میتوان رایانههای هوشمندتری ساخت که قابلیت یادگیری بهتری دارند و در نتیجه میتوانند بصورت هوشمندانهتری به تحلیل و بررسی مسائل بپردازند.

نظر شما در این خصوص چیست؟

نظرات